Apprendre_aux_machines_à_douter_d_elles-mêmes.m4a (31.72 Mo)

Apprendre_aux_machines_à_douter_d_elles-mêmes.m4a (31.72 Mo)

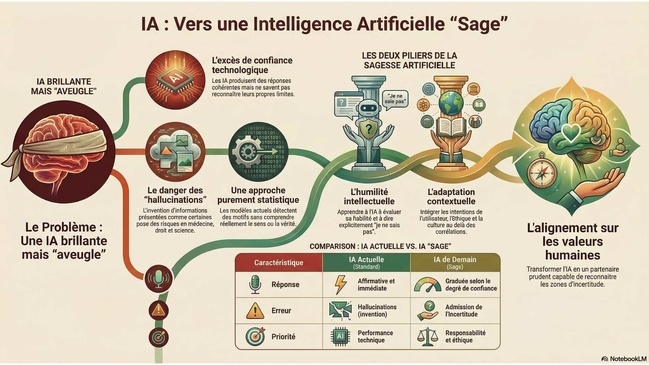

+ Débat - Podcast : les chroniqueurs de la Web Radio R212 débattent des idées et des questions que posent ce sujet : Quand l'intelligence artificielle apprendra à dire « je ne sais pas »

Comment les chercheurs comptent-ils enseigner l'humilité intellectuelle aux modèles d'IA ?

Quels sont les risques concrets des hallucinations de l'IA selon l'article ?

Expliquez-moi le concept de la nouvelle science de l'IA responsable.

Comment les chercheurs comptent-ils enseigner l'humilité intellectuelle aux modèles d'IA ?

Quels sont les risques concrets des hallucinations de l'IA selon l'article ?

Expliquez-moi le concept de la nouvelle science de l'IA responsable.

Vidéo pédagogique qui résume ce sujet : L'IA face à ses limites : pourquoi les algorithmes doivent apprendre à douter