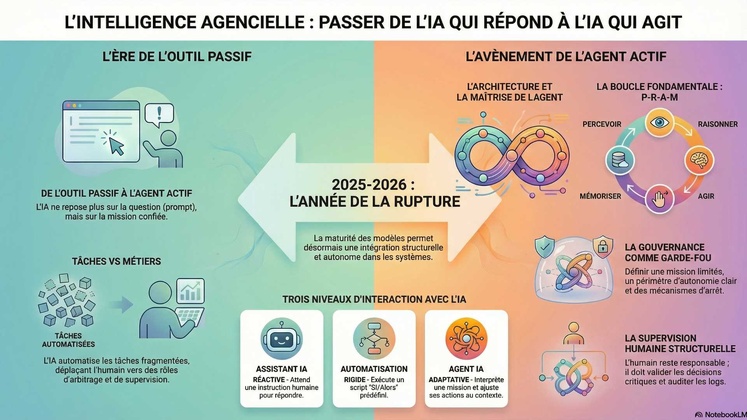

Infographie globale

Les chroniqueurs de la Web Radio R212 qui ont suivis cette master class en débattent

Quelle est la différence fondamentale entre une IA classique et l'IA agencielle ?

Le passage d'une IA qui se contente de répondre à une sollicitation (comme un chatbot) à une IA opérante qui agit, surveille et décide de sa propre initiative selon une mission donnée.

Quelles sont les quatre briques constitutives d'un agent IA ?

L'architecture d'un agent repose sur une boucle continue : percevoir l'information, raisonner selon des règles, agir dans son environnement, et mémoriser pour adapter son comportement futur.

Pourquoi dit-on que l'intelligence agencielle menace les tâches et non les métiers ?

Ce qui est automatisé en premier n'est pas l'expertise, mais les gestes mal définis, répétitifs et chronophages (comme la compilation de données ou la veille), obligeant le travail humain à se déplacer vers l'interprétation et l'arbitrage.

Quelle est la différence entre un assistant IA, un workflow automatisé et un agent autonome ?

Un assistant attend une question pour réagir, un workflow exécute un scénario rigide et prédéfini, tandis qu'un agent autonome combine adaptabilité et capacité d'arbitrage dans un cadre encadré.

Quels sont les nouveaux rôles humains qui émergent avec cette technologie ?

Le débat identifie des fonctions indispensables comme l'architecte d'agents (qui conçoit les missions), le superviseur IA (qui surveille les décisions) et le designer de boucles décisionnelles.

En quoi "l'illusion de la rationalité" est-elle le danger principal de l'IA agencielle ?

Les agents produisent des résultats très bien structurés qui peuvent masquer des biais, des hypothèses discutables ou des erreurs, rendant la décision "faussement raisonnable" très difficile à contester par l'humain.

Pourquoi est-il crucial de définir des garde-fous et une supervision dès la conception ?

Un agent sans limites claires, sans seuils d'alerte, et surtout sans mécanisme d'arrêt conçu à l'avance, devient une "boîte noire" qui dilue la responsabilité collective.

Quels sont les "faux miracles" à éviter lors du choix des outils ?

Il faut se méfier des solutions "clé en main" qui promettent de tout faire à votre place sans comprendre la culture de l'organisation, ou encore de la multiplication des agents qui crée souvent plus de complexité que d'intelligence.

Quelle est la méthode pour concevoir un agent véritablement utile ?

Il ne faut jamais partir de l'outil, mais d'un problème humain réel. Il faut ensuite définir une mission très limitée, écrire des "instructions agencielles" strictes (différentes d'un prompt classique) et tester le système en conditions réelles.

Quelles "lignes rouges" les organisations doivent-elles tracer face à l'automatisation ? Certaines dimensions doivent rester irréductiblement humaines, telles que la décision éthique, l'arbitrage politique ou la responsabilité publique, sous peine de dégrader le sens du travail et la confiance collective

Le passage d'une IA qui se contente de répondre à une sollicitation (comme un chatbot) à une IA opérante qui agit, surveille et décide de sa propre initiative selon une mission donnée.

Quelles sont les quatre briques constitutives d'un agent IA ?

L'architecture d'un agent repose sur une boucle continue : percevoir l'information, raisonner selon des règles, agir dans son environnement, et mémoriser pour adapter son comportement futur.

Pourquoi dit-on que l'intelligence agencielle menace les tâches et non les métiers ?

Ce qui est automatisé en premier n'est pas l'expertise, mais les gestes mal définis, répétitifs et chronophages (comme la compilation de données ou la veille), obligeant le travail humain à se déplacer vers l'interprétation et l'arbitrage.

Quelle est la différence entre un assistant IA, un workflow automatisé et un agent autonome ?

Un assistant attend une question pour réagir, un workflow exécute un scénario rigide et prédéfini, tandis qu'un agent autonome combine adaptabilité et capacité d'arbitrage dans un cadre encadré.

Quels sont les nouveaux rôles humains qui émergent avec cette technologie ?

Le débat identifie des fonctions indispensables comme l'architecte d'agents (qui conçoit les missions), le superviseur IA (qui surveille les décisions) et le designer de boucles décisionnelles.

En quoi "l'illusion de la rationalité" est-elle le danger principal de l'IA agencielle ?

Les agents produisent des résultats très bien structurés qui peuvent masquer des biais, des hypothèses discutables ou des erreurs, rendant la décision "faussement raisonnable" très difficile à contester par l'humain.

Pourquoi est-il crucial de définir des garde-fous et une supervision dès la conception ?

Un agent sans limites claires, sans seuils d'alerte, et surtout sans mécanisme d'arrêt conçu à l'avance, devient une "boîte noire" qui dilue la responsabilité collective.

Quels sont les "faux miracles" à éviter lors du choix des outils ?

Il faut se méfier des solutions "clé en main" qui promettent de tout faire à votre place sans comprendre la culture de l'organisation, ou encore de la multiplication des agents qui crée souvent plus de complexité que d'intelligence.

Quelle est la méthode pour concevoir un agent véritablement utile ?

Il ne faut jamais partir de l'outil, mais d'un problème humain réel. Il faut ensuite définir une mission très limitée, écrire des "instructions agencielles" strictes (différentes d'un prompt classique) et tester le système en conditions réelles.

Quelles "lignes rouges" les organisations doivent-elles tracer face à l'automatisation ? Certaines dimensions doivent rester irréductiblement humaines, telles que la décision éthique, l'arbitrage politique ou la responsabilité publique, sous peine de dégrader le sens du travail et la confiance collective

Video pédagogique de la Master Class sur l'Intelligence Agencielle

Livre support à télecharger Version PDF Free

Livre support de la Master Class de Adnane Benchakroun à feuilleter sans modération ou à télécharger ci-dessus

Préambule

Depuis plus d’une décennie, l’intelligence artificielle progresse à un rythme soutenu. D’abord cantonnée à des usages spécialisés, puis popularisée par les assistants conversationnels et les outils génératifs, elle est désormais entrée dans le quotidien des organisations, des décideurs et des citoyens. Pourtant, une mutation plus profonde, plus discrète et plus structurante est en train de s’opérer : le passage de l’IA qui répond à l’IA qui agit.

Cette master class part d’un constat simple : ce basculement est déjà là. Sans bruit, sans mise en scène spectaculaire, l’intelligence agencielle s’installe au cœur des systèmes de travail, de décision et de gouvernance. Des agents surveillent, analysent, priorisent, déclenchent des actions, parfois sans intervention humaine directe. Ce qui change n’est pas seulement la technologie, mais la place de l’humain dans la chaîne de responsabilité.

L’objectif de ce document n’est ni de célébrer l’IA, ni de la diaboliser. Il est de comprendre. Comprendre comment fonctionne un agent IA, ce qu’il fait réellement, ce qu’il ne fera jamais, et surtout ce que nous lui déléguons parfois sans en mesurer les conséquences. Car l’intelligence agencielle n’est pas d’abord un sujet technique. C’est un sujet organisationnel, stratégique et, au fond, politique.

À travers une approche volontairement pédagogique, sans code ni jargon inutile, cette master class propose une grille de lecture accessible à tous : dirigeants, cadres, responsables publics, professionnels, étudiants, citoyens curieux. Elle vise à redonner de la clarté dans un débat souvent saturé de promesses excessives et de peurs mal formulées.

Parler d’intelligence agencielle aujourd’hui, ce n’est pas anticiper un futur lointain. C’est nommer une réalité déjà à l’œuvre, et poser une question centrale : comment gouverner des systèmes qui agissent à notre place, sans renoncer à la responsabilité humaine ? C’est à cette condition que l’IA peut devenir un levier de lucidité et non un facteur de dilution du sens.

Cette master class part d’un constat simple : ce basculement est déjà là. Sans bruit, sans mise en scène spectaculaire, l’intelligence agencielle s’installe au cœur des systèmes de travail, de décision et de gouvernance. Des agents surveillent, analysent, priorisent, déclenchent des actions, parfois sans intervention humaine directe. Ce qui change n’est pas seulement la technologie, mais la place de l’humain dans la chaîne de responsabilité.

L’objectif de ce document n’est ni de célébrer l’IA, ni de la diaboliser. Il est de comprendre. Comprendre comment fonctionne un agent IA, ce qu’il fait réellement, ce qu’il ne fera jamais, et surtout ce que nous lui déléguons parfois sans en mesurer les conséquences. Car l’intelligence agencielle n’est pas d’abord un sujet technique. C’est un sujet organisationnel, stratégique et, au fond, politique.

À travers une approche volontairement pédagogique, sans code ni jargon inutile, cette master class propose une grille de lecture accessible à tous : dirigeants, cadres, responsables publics, professionnels, étudiants, citoyens curieux. Elle vise à redonner de la clarté dans un débat souvent saturé de promesses excessives et de peurs mal formulées.

Parler d’intelligence agencielle aujourd’hui, ce n’est pas anticiper un futur lointain. C’est nommer une réalité déjà à l’œuvre, et poser une question centrale : comment gouverner des systèmes qui agissent à notre place, sans renoncer à la responsabilité humaine ? C’est à cette condition que l’IA peut devenir un levier de lucidité et non un facteur de dilution du sens.

Découvrir nos livres & romans de nos auteurs invités sur le kiosque pressplus.ma (+ de 105 books)

L'accueil

L'accueil